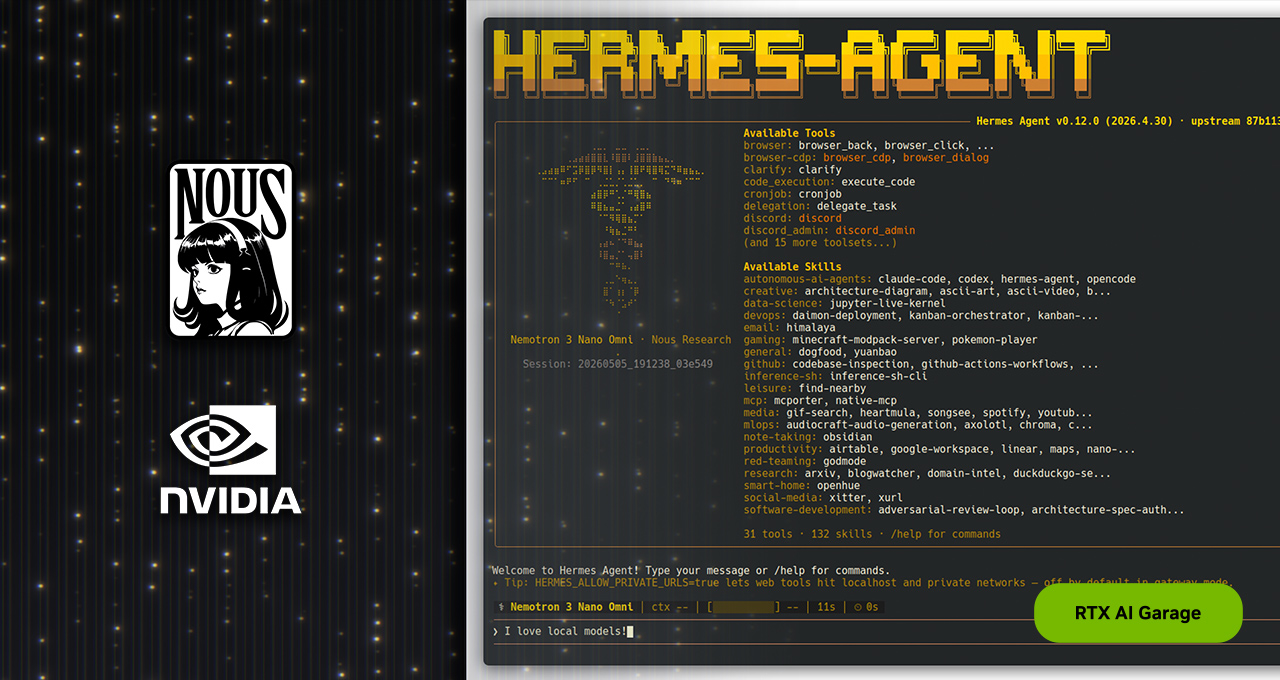

Hermes可靠、可自我進化,並由最新的代理大型語言模型提供支持,為NVIDIA RTX PC和工作站帶來了一類新型代理

智能體人工智慧正在改變使用者完成工作的方式。繼 OpenClaw 取得成功之後,社群正積極擁抱新的開源智能體框架。最新的案例是 Hermes Agent,它在不到三個月的時間內就獲得了超過 14 萬個 GitHub star ,根據OpenRouter 的數據,截至上週,它已成為全球使用最廣泛的智能體。

Hermes 由 Nous Research 開發,旨在實現可靠性和自我改進——這兩點在以往的代理程式中都難以實現。它從設計上就與提供者和模型無關,並針對始終在線的本地使用進行了優化,因此 NVIDIA RTX PC、NVIDIA RTX PRO 工作站和 NVIDIA DGX Spark 是全天候全速運行它的理想硬體。

阿里巴巴推出的全新高效能、開放權重的大型語言模型(LLM)系列-Qwen 3.6,是運行 Hermes 等本地智能體的理想選擇。Qwen 3.6 的 270 億和 350 億參數模型性能優於上一代 1200 億和 4000 億參數模型,並可在 NVIDIA RTX 和 DGX Spark 顯示卡上運行,從而加速智能體的 AI 運行。

Hermes:本地人工智慧代理能力加速

與其他熱門智慧代理一樣,Hermes 可以與即時通訊應用集成,存取本地文件和應用程序,並全天候運行。但它有四項突出的功能使其脫穎而出:

- ● 自我進化技能:Hermes 會寫作並完善自身的技能。每當智能體遇到複雜任務或收到回饋時,它都會將學習成果保存為技能,以便隨著時間的推移不斷適應和改進。

- ● 子代理:Hermes 將子代理視為生命週期短、彼此獨立的個體,它們專注於特定的子任務,並擁有特定的上下文和工具集。這使得任務組織更加清晰,最大限度地減少了代理的困惑,並允許 Hermes 在更小的上下文視窗中運行,這對於局部模型而言非常理想。

- ● 可靠性源自於精心設計:Nous Research 對 Hermes 自帶的每項技能、工具和插件都進行了嚴格的篩選和壓力測試。最終成果:Hermes 開箱即用——即使面對 300 億參數級的本地模型——也無需像大多數其他代理框架那樣進行頻繁的調試。

- ● 同樣的模型,更好的結果:開發者使用相同模型在不同框架中進行對比,結果始終顯示 Hermes 表現更佳。差別在於框架:Hermes 是一個主動式編排層,而非簡單的封裝層,它支援持久化的裝置端代理,而非逐個任務執行。

Hermes 代理程式和底層 LLM 皆設計為本地運作-這意味著硬體品質直接決定使用者體驗的品質。 NVIDIA RTX GPU 專為此類工作負載而設計。

Qwen 3.6:資料中心級智能,在地化

最新的 Qwen 3.6 車型在備受讚譽的 Qwen 3.5 系列的基礎上進行了升級,為本地 AI 代理帶來了另一個飛躍。全新的 Qwen 3.6 35B 型號僅需約 20GB 內存即可運行,其性能卻超越了需要 70GB 以上內存的 1200 億參數模型。

此外,Qwen 3.6 27B 是一款全新的高密度模型,具有更多活躍參數——其精度可媲美 Qwen 3.5 397B 等 4000 億參數模型,而體積卻只有後者的十六分之一。在高階 RTX GPU 上運行,可為該模型提供所需的強大運算能力,從而帶來流暢的體驗。

這些模型非常適合 Hermes 等本地智能體,而 NVIDIA GPU 和 DGX Spark 則是運行它們的最佳方式。 NVIDIA Tensor Core 可加速 AI 推理,從而實現更高的吞吐量和更低的延遲——因此 Hermes 可以在幾秒鐘內完成多步驟任務或改進自身技能,而無需耗費數分鐘。

DGX Spark:始終在線的智慧型計算機

像 Hermes 這樣的智能體旨在持續運作——回應請求、規劃多步驟任務、自主執行並自我改進。 NVIDIA DGX Spark 是其理想搭檔——這是一款緊湊高效的獨立設備,專為持續、全天候的智能體工作流程而設計。

NVIDIA DGX Spark 擁有 128GB 統一記憶體和 1 petaflop 的 AI 效能,可全天候運行 1200 億參數的混合專家模型。而全新的 Qwen 3.6 35B 型號則以更小的體積提供同等的智能,運行速度更快,並支援用戶同時運行多個工作負載。

為了最大限度地發揮性能並提高易用性,請閱讀 Hermes DGX Spark 使用手冊。此外,請報名參加 NVIDIA 「自己動手打造」智能體 AI 系列即將舉辦的實作課程,學習如何使用 NemoClaw 和 OpenShell 建立自主 AI 代理。

NVIDIA DGX Spark 現已可透過 NVIDIA 的製造合作夥伴訂購。

在NVIDIA硬體上使用Hermes入門指南

在 NVIDIA 硬體上本地運行 Hermes 非常簡單。

造訪 Hermes GitHub 程式碼庫即可開始使用,並將其與首選的本地模型和運行時環境搭配使用。您可以透過 llama.cpp、LM Studio 或 Ollama 在 Qwen 3.6 上執行 Hermes。 Hermes Agent 開箱即用,支援 LM Studio 和 Ollama,是部署本地代理的最簡單方法。

無論是探索個人代理前沿的本地人工智慧愛好者,還是為其工作流程建立本地工具的開發人員,NVIDIA 硬體上的 Hermes 都能提供獨特而強大的可靠基礎。

請關注 RTX AI Garage 的更多更新,以了解針對 NVIDIA RTX 硬體優化的最新開放式模型和代理程式。

#ICYMI:RTX AI Garage的最新消息

Google 的 Gemma 4 26B 和 31B 型號現已推出 NVFP4 檢查點版本,可在 NVIDIA Blackwell GPU 上實現更快的效能。將 NVFP4 檢查點與 Google 全新的多標記預測 (Multi-Token Prediction) 草案搭配使用,可在維持相同輸出品質的前提下,將推理速度提升至 3 倍,從而在 NVIDIA GPU 上實現前沿級推理。

Mistral Medium 版本 3.5也於 4 月發布,其中包含與 llama.cpp 和 Ollama 的兼容性更新,使用戶能夠在 NVIDIA RTX PRO 和 DGX Spark 系統上運行。