今天,我們隆重推出 Gemma 4 ——迄今為止我們最聰明的開放模型。 Gemma 4 專為高階推理和智能體工作流程而打造,實現了前所未有的參數智慧水準。

這項突破建立在社群的強大推動力之上:自第一代產品發布以來,開發者已下載 Gemma 超過 4 億次,構建了一個擁有超過 10 萬個變體的充滿活力的 Gemma 生態系統。我們認真傾聽了創新者們的需求,了解他們如何才能進一步拓展人工智慧的邊界,而 Gemma 4 正是我們的答案:突破性的功能,並以 Apache 2.0 許可證廣泛開放。

Gemma 4 採用與 Gemini 3 相同的世界一流研發技術,是您硬體上可運行的功能最強大的模型系列。它們與我們的 Gemini 模型相輔相成,為開發者提供業界最強大的開源和專有工具組合。

業界領先的功能和行動優先的人工智慧

我們發布了四種不同規模的 Gemma 4:Effective 2B (E2B )、Effective 4B (E4B)、26B Mixture of Experts (MoE) 和 31B Dense。整個 Gemma 系列超越了簡單的聊天,能夠處理複雜的邏輯和智慧體工作流程。

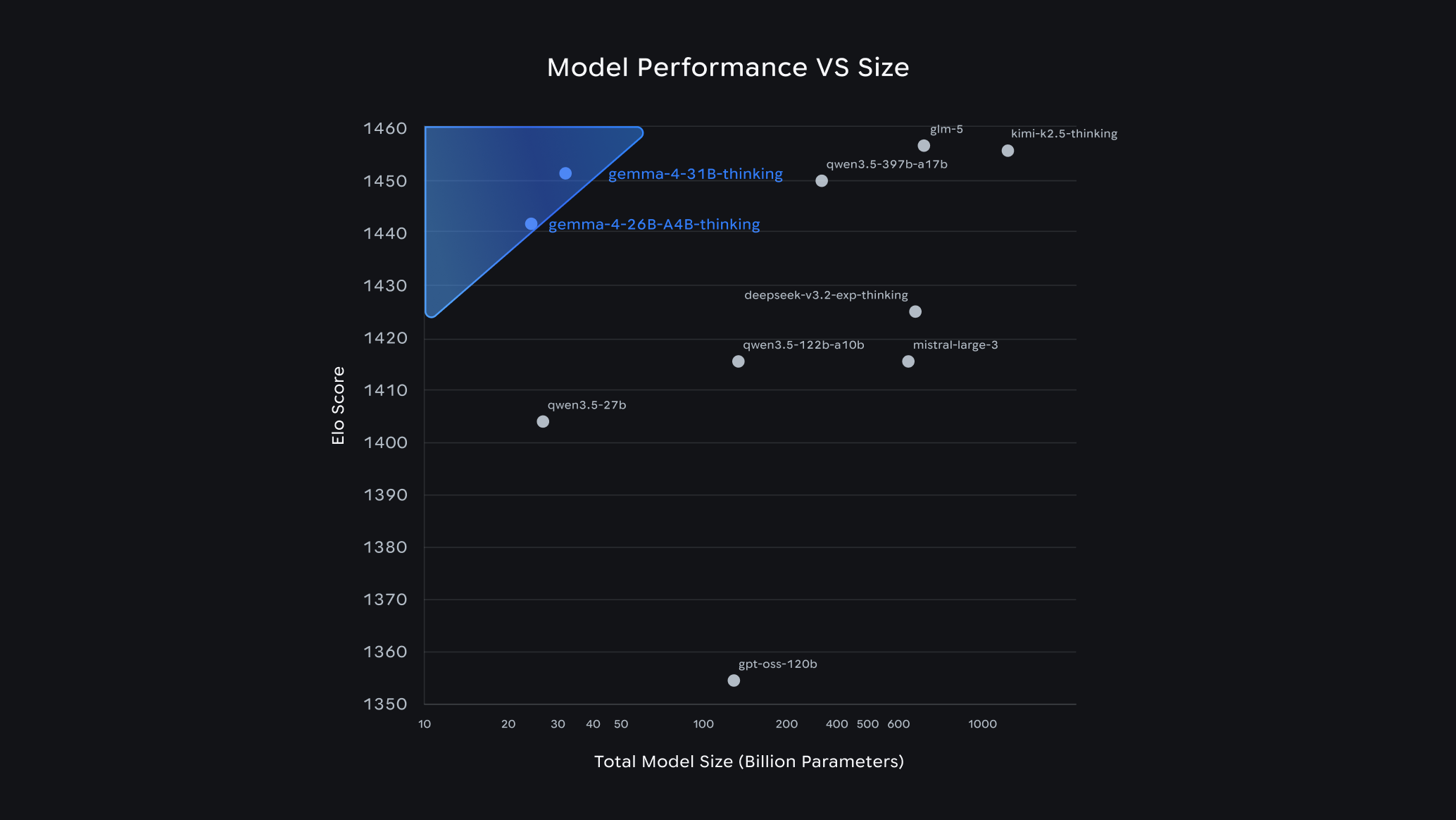

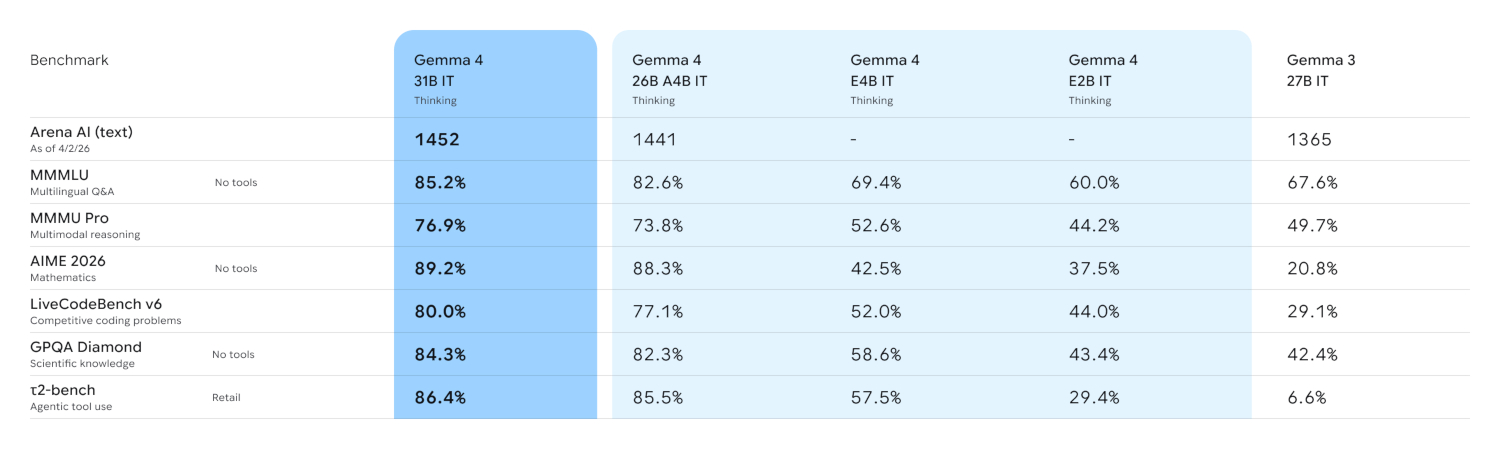

我們更大的模型在同等規模下實現了卓越的性能,其中 31B 模型目前在行業標準的 Arena AI 文本排行榜上位列全球第三,26B 模型位列第六。 Gemma 4 的性能甚至超越了規模是其 20 倍的模型。對於開發者而言,這種全新的參數智慧水準意味著能夠以更低的硬體開銷實現前沿級的功能。

▲What’s new in Gemma 4

在邊緣端,我們的 E2B 和 E4B 模型重新定義了設備上的實用性,優先考慮多模態功能、低延遲處理和無縫生態系統集成,而不是原始參數數量。

強大、易用、開放

為了推動下一代開創性研究和產品的開發,我們專門針對各種硬體對 Gemma 4 型號進行了尺寸設計,使其能夠高效運行和微調——從全球數十億台 Android 設備,到筆記型電腦 GPU,再到開發者工作站和加速器。

透過使用這些高度最佳化的模型,您可以對 Gemma 4 進行微調,從而在特定任務上實現最先進的效能。我們已經見證了這種方法的顯著成功;例如,INSAIT 創建了一個開創性的保加利亞語優先語言模型 ( BgGPT ),我們還與耶魯大學合作開發了 Cell2Sentence-Scale,用於探索癌症治療的新途徑,等等。

以下是Gemma 4成為我們迄今為止功能最強大的開放式模型系列的原因:

- ● 高階推理能力: Gemma 4 能夠進行多步驟規劃和深度邏輯推理,在需要這種能力的數學和指令遵循基準測試中表現出顯著的進步。

- ● 代理工作流程:原生支援函數呼叫、結構化 JSON 輸出和原生系統指令,使您能夠建立可與不同工具和 API 互動並可靠地執行工作流程的自主代理。

- ● 程式碼產生: Gemma 4 支援高品質的離線程式碼,將您的工作站變成本地優先的 AI 程式碼助理。

- ● 視覺和音訊:所有型號均原生支援視訊和影像處理,支援多種分辨率,並在光學字元辨識 (OCR) 和圖表識別等視覺任務中表現出色。此外,E2B 和 E4B 型號還具備原生音訊輸入功能,可用於語音辨識和理解。

- ● 更長的上下文:無縫處理長篇內容。邊緣機型配備 128K 的上下文窗口,而更大型號則提供高達 256K 的上下文窗口,可讓您在一次提示中處理儲存庫或長文件。

- ● 140 多種語言: Gemma 4 原生支援 140 多種語言,可協助開發者為全球使用者建立包容性強、高效能的應用程式。

適用於各種硬體的多功能模型

我們將發布針對特定硬體和使用場景量身定制的 Gemma 4 模型權重,確保您無論何時何地都能獲得一流的推理能力:

26B和31B型號:Frontier Intelligence,可在您的個人電腦上離線使用

我們的模型經過最佳化,旨在為研究人員和開發人員在易於使用的硬體上提供最先進的推理能力。未量化的 bfloat16 權重可以有效地加載到單一 80GB NVIDIA H100 GPU 上。對於本機部署,量化版本可在消費級 GPU 上原生運行,為您的 IDE、編碼助理和智慧體工作流程提供強大支援。我們的 260 億混合專家模型 (MoE) 專注於降低延遲,在推理過程中僅激活其全部參數中的 38 億個,從而實現極快的每秒詞元數;而我們的 310 億密集模型則最大限度地提高了原始質量,並為微調提供了強大的基礎。

E2B和E4B模型:行動和物聯網設備智慧的新境界

這些模型從設計之初就旨在最大限度地提高運算和記憶體效率,在推理過程中可有效啟動 20 億至 40 億個參數,從而節省 RAM 並延長電池續航時間。我們與 Google Pixel 團隊以及高通和聯發科等行動硬體領導者緊密合作,這些多模態模型可在手機、樹莓派和 NVIDIA Jetson Orin Nano 等邊緣設備上完全離線運行,延遲接近零。 Android 開發者現在即可在AICore 開發者預覽版中建立代理流程原型,以實現與 Gemini Nano 4 的向前相容性。

開源許可證

您提出了回饋意見,我們認真聽取了。建構人工智慧的未來需要協作,我們相信應該在不設置限制性障礙的情況下賦能開發者生態系統。因此,Gemma 4 採用商業上較為寬鬆的Apache 2.0 授權發布。

此開源授權為開發者提供了充分的靈活性和數位主權,賦予您對資料、基礎架構和模型的完全控制權。它允許您自由建置並安全地部署到任何環境,無論是在本地端還是在雲端。

“Gemma 4 以 Apache 2.0 許可證發布是一個重要的里程碑。我們非常興奮能夠從發布第一天起就在 Hugging Face 上為 Gemma 4 用戶提供支持。”

Clément Delangue co-founder and CEO, Hugging Face

建立在信任和安全的基礎上

這些模型與我們的專有模型一樣,均經過嚴格的基礎設施安全協定驗證。選擇 Gemma 4,企業和主權組織即可獲得一個值得信賴、透明的基礎架構,不僅提供最先進的功能,還能滿足最高的安全性和可靠性標準。

選擇的生態系統

- ● 立即開始體驗:快速取得 Gemma 4 並立即開始建置。您可以在 Google AI Studio(31B 和 26B MoE)或 Google AI Edge Gallery(E4B 和 E2B)中探索 Gemma 4。對於 Android 開發,您可以使用它來增強Android Studio中的代理模式,並使用 ML Kit GenAI Prompt API 開始建立用於 Android 生產環境的應用程式。

- ● 使用您喜歡的工具:從第一天起就支援Hugging Face ( Transformers、TRL 、 Transformers.js、Candle)、LiteRT -LM 、 vLLM、llama.cpp、MLX、Ollama、NVIDIA NIM 和 NeMo、LM Studio、Unsloth、、MaxText、Tunix、Keras,您可以靈活地為您的專案選擇最佳工具。

- ● 下載模型:從 Hugging Face、Kaggle 或 Ollama 取得模型權重。

- ● 根據您的特定需求自訂 Gemma 4:使用您喜歡的平台(例如 Google Colab、 Vertex AI 甚至您的遊戲 GPU)訓練和調整模型。

- ● 在 Google Cloud 擴展到生產環境:雖然本機裝置推理非常適合離線使用,但 Google Cloud 突破了所有運算上限。您可以藉助 Vertex AI、Cloud Run、GKE 、Sovereign Cloud、TPU 加速服務以及針對受監管工作負載的最高合規性保證,輕鬆部署。點擊此處了解更多關於 Google Cloud 入門的資訊。

- ● 加速跨多個硬體平台的 AI 開發: Gemma 4 開箱即用,針對業界領先的硬體進行了最佳化。在 NVIDIA AI 基礎架構(從 NVIDIA Jetson Orin Nano 到 Blackwell GPU)上體驗極致效能,透過開源 ROCm™ 堆疊與 AMD GPU 集成,或部署在 Trillium 和 Ironwood TPU 上,實現大規模擴展和高效運行。

- ● 參與競爭,創造影響力:加入 Kaggle 上的 Gemma 4 Good 挑戰賽,打造能夠為世界帶來有意義的積極改變的產品。