目前許多基礎設施規劃會議上都在討論這樣一個問題:“智能體人工智慧將會改變 CPU 與 GPU 的比例。所以,我們只需要在 GPU 伺服器中添加更多的 CPU,對嗎?”

聽起來合情合理。但很多人也正是在這一點上犯了錯。

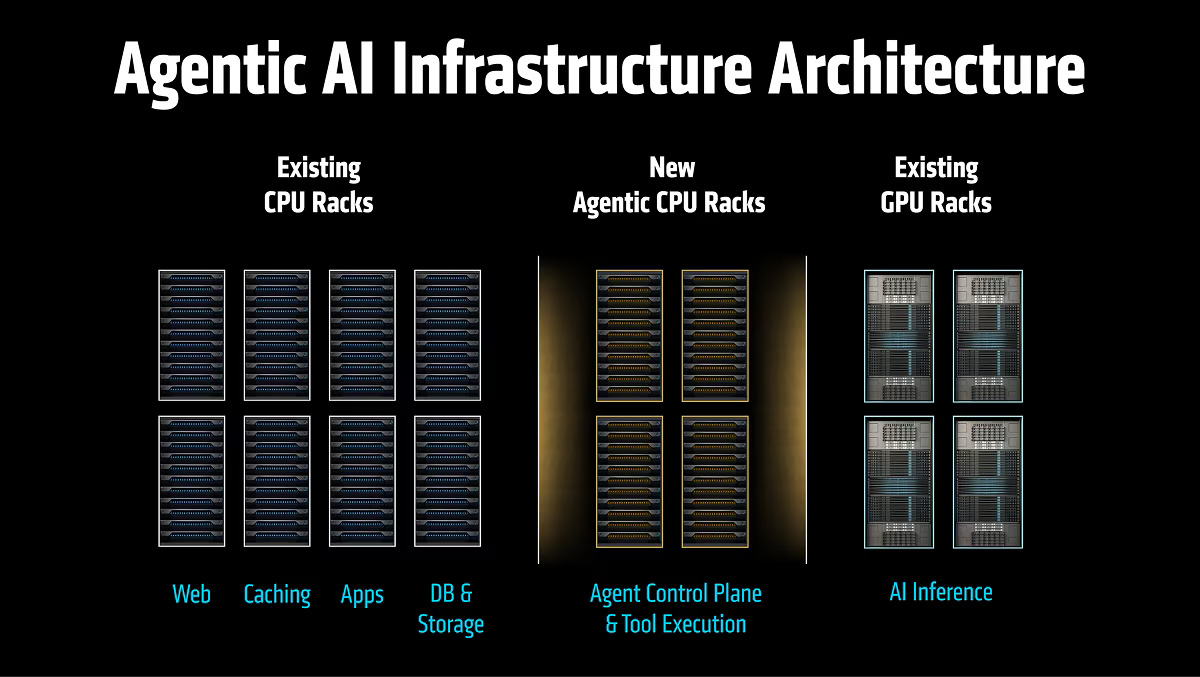

從聊天機器人式人工智慧到智慧體人工智慧的轉變,並非僅僅是在原有的 GPU 密集型機架旁增加幾台 CPU 那麼簡單。它的意義遠不止於此,而是資料中心架構的結構性變革。智能體人工智慧正在推動對全新 CPU 伺服器機架的需求,這些伺服器與 GPU 基礎架構並肩運行,為所有這些智慧體提供支援。

對企業 IT 領導者而言,這一切蘊含著一個教訓:智能體 AI 改寫了 AI 基礎架構的格局。

AMD 一直在密切關注這一轉變。雖然我們先前預測伺服器 CPU 市場將以每年 18% 的速度成長,但由智慧代理驅動的運算需求結構性成長改變了這個預測。我們現在預計伺服器 CPU 市場總規模將以每年超過 35% 的速度成長,到 2030 年將超過 1200 億美元。

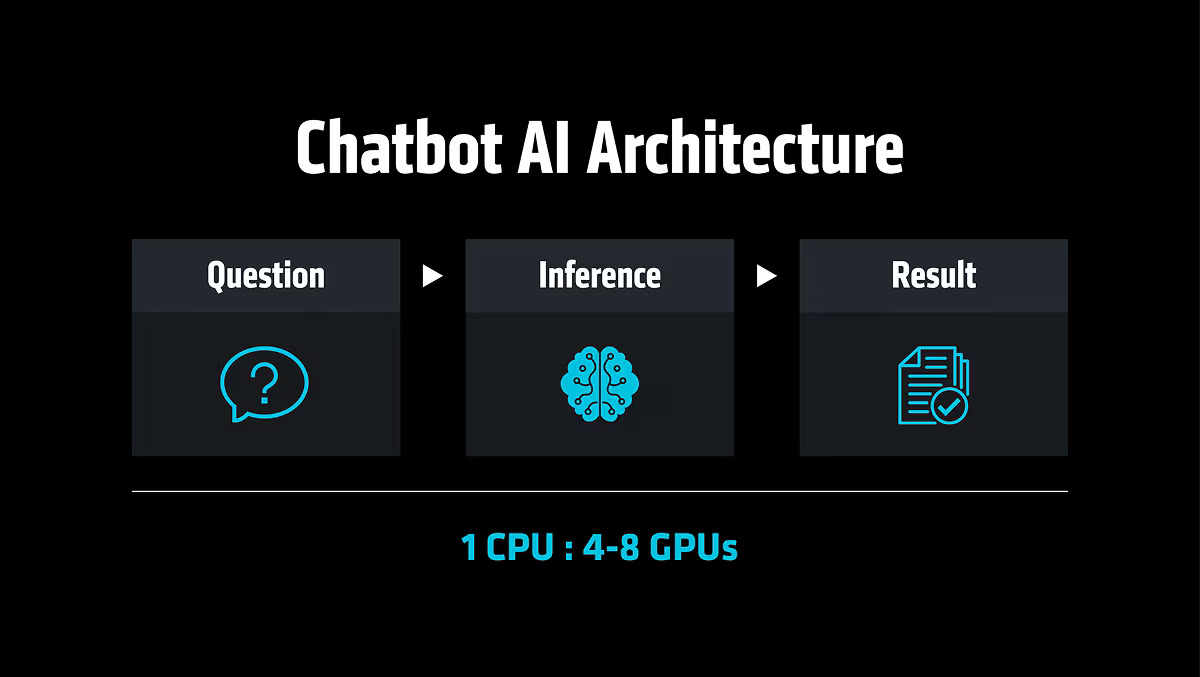

第一波浪潮:聊天機器人人工智慧主要以模型回應為主

生成式人工智慧的第一波浪潮建立在一個相當簡單的模式之上:用戶提出問題;應用程式向模型發送提示;模型生成答案;應用程式將答案傳回給用戶。

這種架構自然而然地催生了以 GPU 為中心的設計。在這些部署中,一個 CPU 作為伺服器的主節點,連接四到八個 GPU。主節點 CPU 負責調度、I/O 和系統管理,而 GPU 則負責繁重的運算任務。

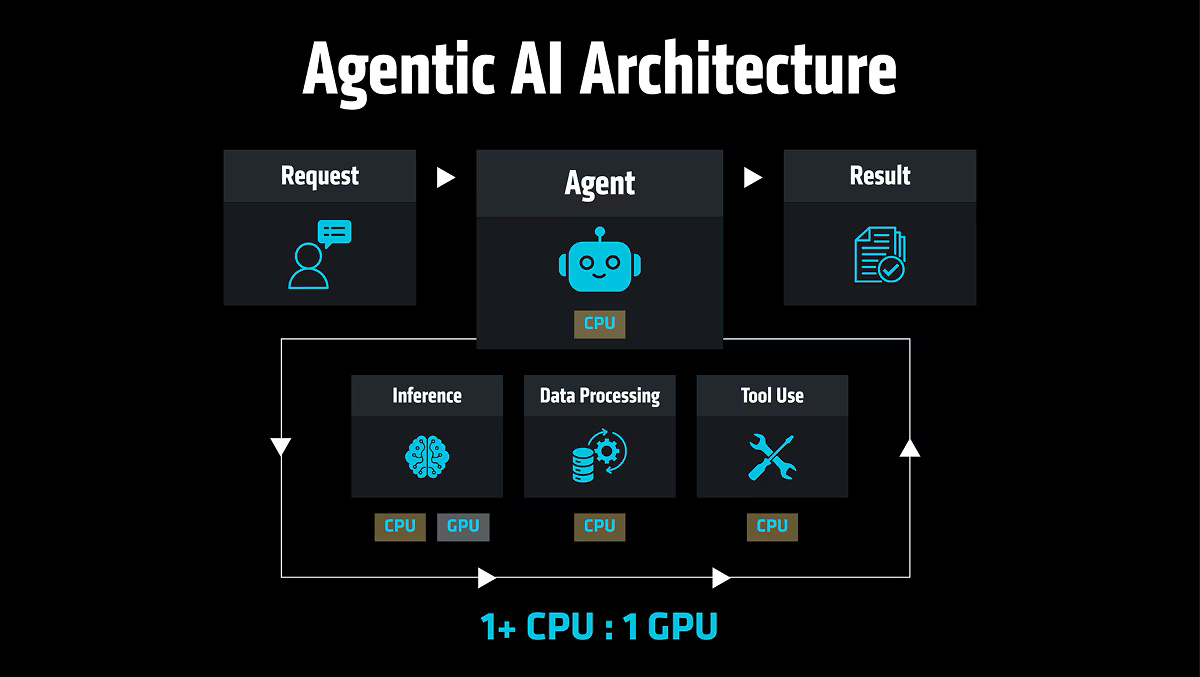

智能體人工智慧不僅僅是“聊天加工具”

我們現在正處於智能體人工智慧時代的初期。在這個時代,工作負載的形態發生了徹底的改變。智能體不再只是回答一個問題,而是將目標分解成多個步驟,決定下一步該做什麼,調用多個模型,查詢資料庫,連接 API,運行企業應用程序,檢查權限,檢索內存,驗證輸出,然後再次循環執行整個過程。這與傳統的「輸入提示,輸出答案」的聊天機器人人工智慧的架構截然不同。

GPU 對於模型執行仍然至關重要,但生產環境中的工作負載現在主要依賴 CPU。 CPU 負責:

- ● 編排:管理分解複雜任務的引擎。

- ● 代理執行和工具呼叫:觸發 API 和傳統企業軟體。

- ● 策略與安全:對每個自主操作進行實際檢查。

解決CPU-GPU轉換問題的答案並非只是「增加CPU數量」。

與先前聊天機器人 AI 中 CPU 與 GPU 的比例為 1:4-8 不同,我們看到智慧 AI 的比例正朝著 1:1 的方向發展,在某些情況下,CPU 的比例甚至更高。

關鍵在於:這並非簡單地在 GPU 盒子裡塞入更多 CPU 就能實現的,而是需要增加一個全新設計的 CPU 運算層。

對企業 IT 領導者而言,這就是你們的規劃需要改進的地方。

未來幾年,人工智慧系統的首選方案不會是單一的 “AI 盒子”,而更像是分散式系統。它將配備用於密集模型計算的 GPU 機架、高速網路以及能夠確保所有組件可觀測、安全且高效的軟體堆疊。此外,還將配備用於編排、資料處理和工具執行的智慧體 CPU 機架。

如今,均衡的架構比以往任何時候都更重要。如果 CPU 層配置不足,GPU 就會被動等待。如果網路架構被忽視,代理程式就會停滯不前。如果資料路徑混亂,延遲就會增加。如果編排層沒有針對並發進行設計,成本和複雜性就會上升。

AMD的市場定位

AMD EPYC™ 處理器為客戶提供豐富的 CPU 選擇,針對 AI 管線的不同環節進行了優化,從對延遲敏感型任務的高頻率性能到橫向擴展吞吐量的高密度核心性能,應有盡有。

我們正透過目前的產品路線圖不斷鞏固這一領先地位,其中包括「Venice」系列產品,該系列產品將進一步擴展 AI 優化 CPU 的產品組合。最終,我們將提供專用晶片,以滿足您資料中心每個機架(以及雲端環境中每個運算實例)的特定需求。

IT領導者可藉鏡的實務經驗

我再說一遍,智能體人工智慧正在改變基礎設施格局。

我向企業 IT 決策者提出請求:隨著智慧體人工智慧從試點階段過渡到生產階段,在規劃基礎設施規模時,不要像僅僅為企業添加一個聊天機器人。而應該將其視為一種新型數位勞動力的加入——他們需要全天候進行規劃、行動、檢查、檢索、調用工具和執行工作流程。

這意味著需要規劃比以往人工智慧假設更高的 CPU 容量。這意味著要超越 GPU 伺服器的限制,考慮機架、網路架構、軟體和維運平衡等問題。在智能體時代,效能不再來自單一處理器包辦一切,而是來自合適的架構- CPU 和 GPU 協同工作,推動人工智慧從回答問題到採取行動。

(本文作者:Dan McNamara , Senior Vice President and General Manager, Compute & Enterprise AI)