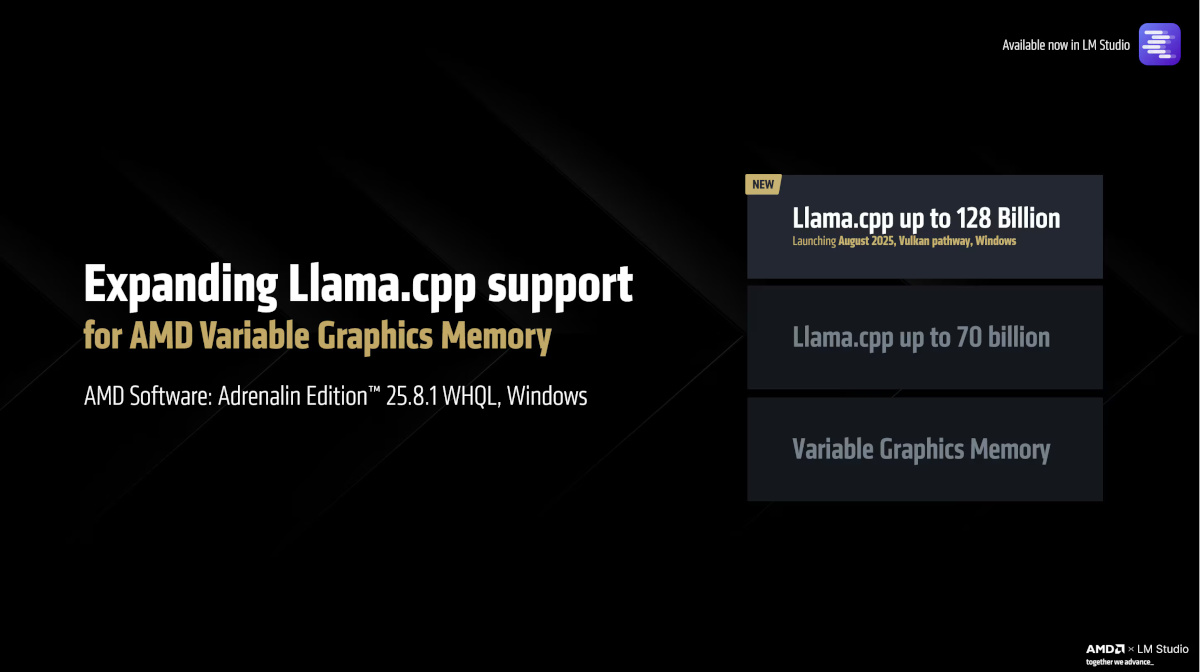

AMD 宣布將透過即將釋出的 AMD Software: Adrenalin Edition 25.8.1 版驅動軟體,推出全新 KB 驅動程式,讓搭載 Ryzen™ AI Max+ 395 處理器並配備 128GB 記憶體的 Windows AI PC,能夠在本地運行高達 128B 參數的大型語言模型(LLM),其規模約與 ChatGPT 3.0 相當。這項突破性成就,更包含透過 llama.cpp 及 Vulkan 技術,支援具備完整視覺功能與模型上下文協定(Model Context Protocol, MCP)的 Meta Llama 4 Scout 109B 模型,標誌著 Ryzen AI Max+ 395 處理器是首款能夠運行此規模模型的消費級處理器。

過去,這類大規模的模型通常僅能透過雲端服務存取。然而,本地 AI 具備多重優勢,不僅能提供更佳的資料控制權、有效降低長期營運成本,更能透過免除對第三方基礎設施的依賴,大幅提升使用者隱私。透過本次更新,AMD 讓使用者能夠直接在裝置上運行這些先進模型,為 AI 部署帶來更高靈活性。

藉由讓 Windows PC 支援過去僅限於大型雲端基礎設施運行的模型,AMD 正協助改變進階 AI 的運行地點。這不僅是將雲端等級的運算能力帶到桌上型電腦,更是全面擴展 AI 在本地應用、建構和部署的可能性。

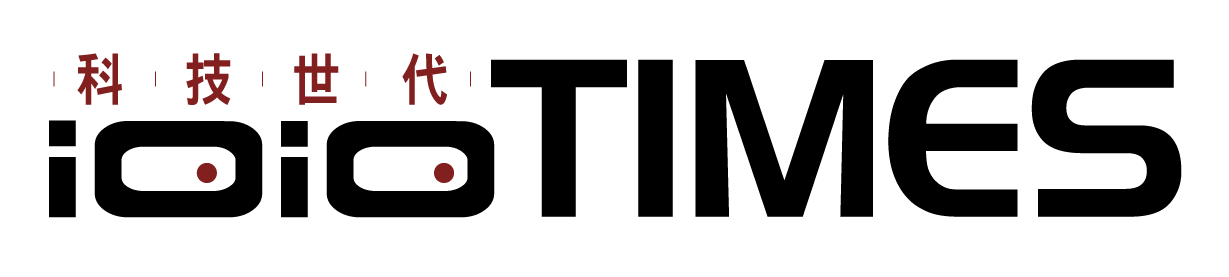

透過重新分配系統記憶體,AMD 可變顯示記憶體(Variable Graphics Memory, VGM)技術獲得顯著強化,能為 iGPU 提供高達 96GB 的連續專用顯示記憶體,使得大型模型(4位元精度下的128B參數,或FP16精度下的32B參數)都能在無需獨立 GPU 的情況下,於本地順暢運行。

憑藉最新的 Adrenalin 驅動軟體,AMD 能夠實現以下關鍵突破:

● 首款能夠在本地運行 Llama 4 Scout 109B 模型的 Windows AI PC,並具備完整視覺和工具使用功能。

● 支援 256,000 個 token 的上下文視窗,適用於長篇文件處理、多步驟推理和 AI 代理工作流程。

● 提供極致的彈性,能夠運行各式各樣的模型,從輕量級的 AI 助理,到用於程式編碼和視覺任務的進階工具。