透過使用 Multi-Token Prediction (MTP) 產生器,Gemma 4 模型減少了延遲瓶頸,並為開發人員實現了更高的反應速度。

就在幾週前,我們推出了迄今為止功能最強大的開放式 Gemma 4。短短幾週內,Gemma 4 的下載量就超過了 6,000 萬次,為開發者工作站、行動裝置和雲端帶來了前所未有的參數級智慧。今天,我們將效率提升到一個新的高度。

我們發布了適用於 Gemma 4 系列的 Multi-Token Prediction (MTP) 代碼草稿器。這些程式碼草稿器採用專門的推測性解碼架構,可在不降低輸出品質或推理邏輯的前提下,實現高達 3 倍的速度提升。

為什麼採用推測性解碼?

技術上的現實是,標準的 LLM 推理受限於記憶體頻寬,從而造成嚴重的延遲瓶頸。處理器的大部分時間都花在將數十億個參數從顯存(VRAM)傳輸到運算單元,而這只是為了產生一個 Token Prediction。這會導致運算資源利用率不足和高延遲,尤其是在消費級硬體上。

推測性解碼將 Token Prediction 產生與驗證解耦。透過將一個複雜的目標模型(例如 Gemma 4 31B)與一個輕量級的產生器(MTP 模型)配對,我們可以利用閒置的計算資源,讓產生器同時「預測」多個未來的令牌,其耗時甚至比目標模型處理單一 Token Prediction 所需的時間還要短。然後,目標模型並行驗證所有這些預測的 Token Prediction。

推測性解碼的工作原理

標準的大型語言模型採用自回歸的方式產生文本,每次只產生一個詞元。雖然這種方法有效,但它在預測顯而易見的後續內容(例如預測「行動勝於雄辯…」之後的「詞語」)和解決複雜的邏輯難題時,所消耗的計算量幾乎相同。

MTP 透過推測性解碼來緩解這種效率低下的問題。推測性解碼是 Google 研究人員在《透過推測性解碼從 Transformer 中快速推理》一文中提出的技術。如果目標模型認同草稿,它會在一次前向傳播中接受整個序列,甚至在過程中產生額外的標記。這意味著您的應用程式可以在通常產生一個標記所需的時間內,輸出完整的草稿序列以及一個額外的標記。

從邊緣到工作站,解鎖更快速的人工智慧

對於開發者而言,推理速度通常是生產部署的主要瓶頸。無論您是建立編碼助理、需要快速多步驟規劃的自主代理,還是完全在設備端運行的響應式行動應用程序,每一毫秒都至關重要。

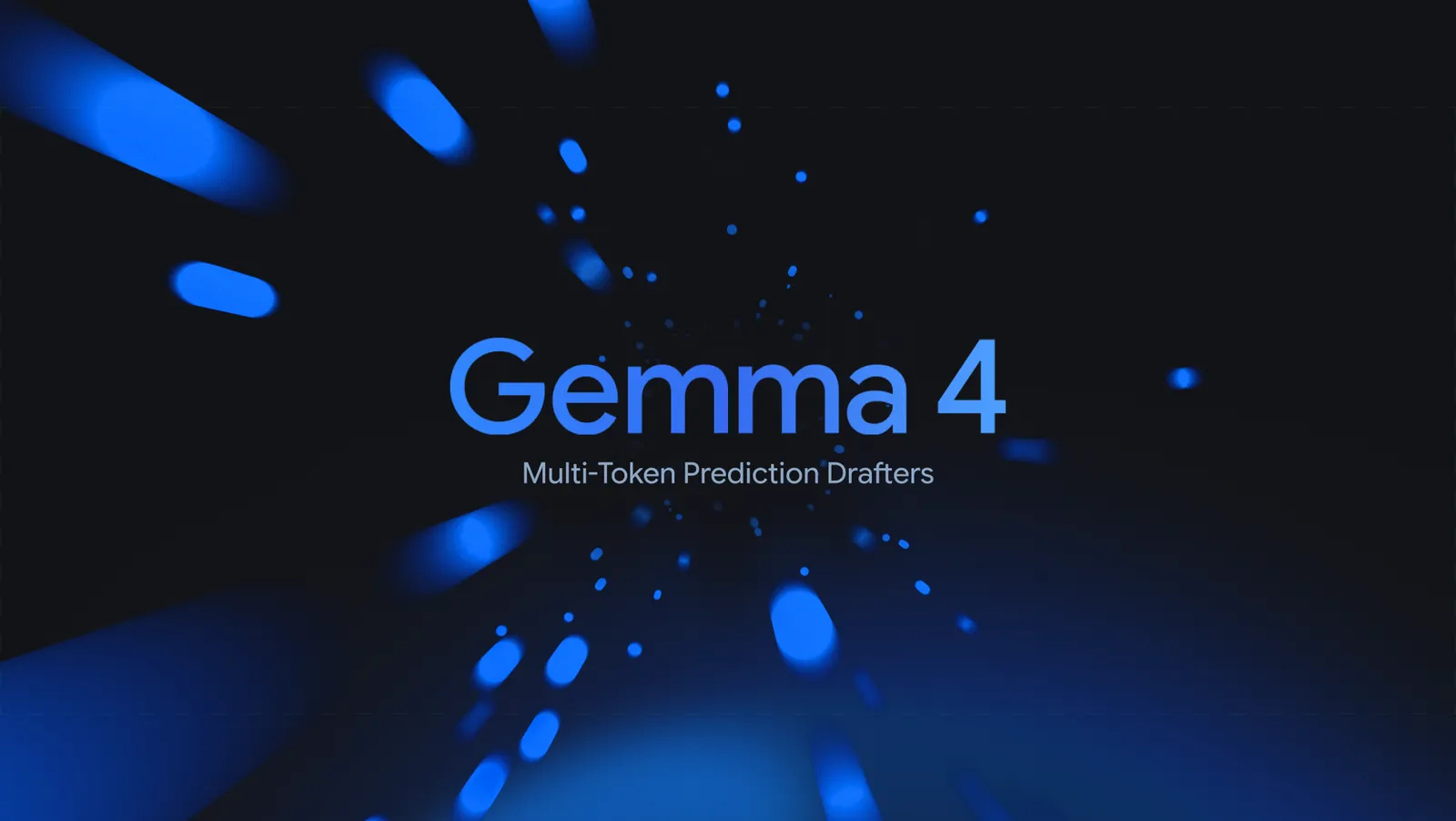

透過將 Gemma 4 模型與其對應的繪圖軟體搭配使用,開發人員可以實現以下目標:

- ● 提高回應速度:大幅降低近即時聊天、沉浸式語音應用和代理工作流程的延遲。

- ● 超強本地開發:在個人電腦和消費級 GPU 上以空前的速度運行我們的 260 億 MoE 和 310 億 Dense 模型,從而實現無縫、複雜的離線編碼和代理工作流程。

- ● 增強設備端性能:透過更快產生輸出,最大限度地發揮 E2B 和 E4B 型號在邊緣設備上的效用,從而節省寶貴的電池壽命。

- ● 品質零下降:由於主要的 Gemma 4 模型保留了最終驗證,因此您可以獲得相同的前沿推理和準確性,只是交付速度快得多。

您可以在這裡深入了解MTP製圖程序

為了讓這些 MTP 草圖產生器擁有極高的速度和準確性,我們在底層引入了多項架構改進。草圖模型能夠無縫利用目標模型的啟動值並共享其鍵值緩存,這意味著它們無需浪費時間重新計算大型模型已經識別的上下文。對於我們的 E2B 和 E4B 邊緣模型,由於最終的 logit 運算成為效能瓶頸,我們甚至在嵌入器中實現了一種高效的聚類技術,以進一步加速生成過程。

我們也一直在密切分析針對特定硬體的最佳化。例如,雖然在 Apple Silicon 上,26B 混合專家模型在批次大小為 1 時會帶來獨特的路由挑戰,但同時處理多個請求(例如,批次大小為 4 到 8)可以在本地實現高達約 2.2 倍的速度提升。我們在 Nvidia A100 上也觀察到了類似的效能提升,即增加批次大小。

想了解其具體運作原理嗎?我們發布了一篇深入的技術說明文章,詳細解讀了這些繪圖器背後的視覺化架構、KV 快取共享和高效嵌入器。

如何開始

適用於 Gemma 4 系列的 MTP 模型產生器現已發布,採用與 Gemma 4 相同的開源 Apache 2.0 授權。請閱讀文檔,以了解如何將 MTP 與 Gemma 4 結合使用。現在您即可在 Hugging Face 和 Kaggle 上下載模型權重,並開始嘗試使用 Transformer、MLX、VLLM 、SGLang 和 Ollama 進行更快的推理,或者直接在適用於Android 或 iOS 的 Google AI Edge Gallery 上進行嘗試。

我們迫不及待地想看看這種新獲得的速度將如何加速你在 Gemmaverse 中的下一個創作。

(本文為 Google 英文新聞稿翻譯)